Wie de enorme toename van de hoeveelheid data de komende jaren wil opvangen zonder daarvoor enorme investeringen te hoeven doen, zal moeten innoveren. Dat kan door traditionele uitgangspunten van datacenterbeheer tegen het licht te houden en daarbij terug te gaan naar de bron. Dan blijkt dat veel zaken op een andere manier even goed of zelfs stukken efficiënter en bovenal aanzienlijk goedkoper kunnen worden geregeld.

Datacenters worden ontworpen en gebouwd op basis van uitgangspunten die historisch hun waarde hebben bewezen. Dat wil echter niet zeggen dat deze uitgangspunten eeuwigheidswaarde hebben. Innovatie is mogelijk door deze basisveronderstellingen tegen het licht te houden en te kijken of ze nog steeds volledig opgeld doen tegen de achtergrond van gewijzigde omstandigheden.

Ik wil in deze blog ingaan op vier veel voorkomende uitgangspunten, te weten: de (mechanische) koeling moet het altijd doen; netwerkcomponenten moeten aan de achterzijde van het rack geplaatst worden; de componenten moeten zo dicht mogelijk bij elkaar worden geplaatst; en alle componenten moeten continu stand by zijn.

Overweeg free air cooling

Koeling is geen doel op zich. Het is een middel om de componenten een optimale omgeving te bieden en dit middel draagt bij aan de operationele continuïteit. Dat laatste is uiteraard het doel.

Nu is het zo dat fabrikanten van processoren en andere componenten een zogeheten recommended envelope aanbieden. Dit is een aanbevolen bandbreedte voor de bedrijfstemperatuur en luchtvochtigheid bij het gebruik van zulke componenten. Voor processoren bevindt de aanbevolen omgevingstemperatuur zich in de regel tussen 18 en 27 graden celcius. Onder de 18 graden neemt de relatieve luchtvochtigheid teveel toe, met daarmee verbonden risico’s van schade aan componenten. Boven de 27 graden zijn er geen directe risico’s. Het is dan ook een tamelijk arbitraire grens. Veel processoren functioneren zelfs nog uitstekend bij temperaturen van 60 graden celcius. Verderop in dit artikel komen we hier nog op terug.

Waar het nu om gaat is dat het – als we naar de specs van de leveranciers kijken – heel goed mogelijk is om een goed draaiend datacenter te hebben met een luchttemperatuur van 27 graden. Veel managers van datacenters houden echter veiligheidshalve een temperatuur van 18 of 19 graden celcius aan, hetgeen erg veel energie kost, omdat daarvoor koelmachines moeten worden ingezet.

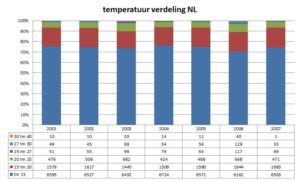

Onnodig, want koelen tot 27 graden kan in ons land prima met behulp van buitenlucht. Zie daarvoor nevenstaande grafiek met de temperatuurverdeling van 2001 tot en met 2007. Daaruit blijkt dat de gemiddelde buitentemperatuur 98 procent van de tijd onder de 27 graden ligt.

De ervaring die de afgelopen jaren met free air cooling in Nederland is opgedaan leert dat dit 85 procent besparing op de energiekosten voor koeling oplevert.

Voorkom botsende luchtstromen in het rack

Cruciaal voor een zo efficiënt mogelijke koeling in een datacenter is het gescheiden houden van warme en koude luchtstromen. Deze luchtbehandeling kan op twee manieren plaatsvinden: warme lucht aan de voorzijde van de componenten afvoeren (warme gang) of andersom, aan de achterzijde (koude gang). So far so good. Ware het niet dat er componenten zijn die van zichzelf in de tegenovergestelde richting werken.

Weliswaar worden de meeste servers ontworpen en gebouwd op basis van een front-to-rear koelstrategie met patching aan de achterkant – en dat past uiteraard prima bij het koudegangprincipe -, maar voor switches en routers geldt dat in de meeste gevallen niet. Zij zijn precies andersom gebouwd, namelijk front to rear met patching aan de voorkant. En zo ontstaan er in de basis van het ontwerp van het datacenter al tegenstrijdige warmtebewegingen. Het botst al aan de bron.

Met het beter richten van de luchtstromen binnen het rack (in cabinet airflow management) is dit probleem voor een groot deel op te vangen. Maar de fundamentele oplossing is dat fabrikanten van switches en routers producten op de markt gaan brengen die beter aansluiten op de overige componenten in het rack.

Breng lucht tussen de componenten

Het uitgangspunt dat componenten dicht op elkaar geplaatst moeten worden stamt uit de tijd waarin de apparatuur nog een aanzienlijke omvang had en dus veel vloeroppervlak innam. Die situatie bestaat inmiddels niet meer. Volgens onderzoeksbureau Gartner is het mogelijk de benodigde capaciteitstoename in de komende vijftien tot twintig jaar te realiseren op het bestaande vloeroppervlak. Dat kan door nieuwere, smalle servertypes in gebruik te nemen en door de toepassing van nieuwe inzichten op het gebied van de koeling en de inrichting van datacenters.

Het mooie aan deze nieuwe situatie is dat het daardoor mogelijk wordt de componenten anders te gaan positioneren in het rack. Niet dichter op elkaar, zoals voorheen, maar juist ruimer, zodat de koele lucht aan de bron kan komen. Dit voorkomt de vorming van hotspots die veel moeilijker te koelen zijn met als gevolg dat de omgevingstemperatuur onnodig oploopt.

Experimenteer eens met uitzetten

Datacenters worden nog steeds gebouwd volgens de always-on-gedachte. Alle componenten die in gebruik zijn staan 24×7 ingeschakeld, ongeacht de op dat moment benodigde capaciteit. In het verleden was dit logisch, omdat specifieke taken toen toegewezen waren aan specifieke fysieke machines. Maar nu virtualisatie en clustertechnologie een hoge vlucht hebben genomen is dit niet meer nodig.

Dankzij deze nieuwe technologieën kan op elk moment capaciteit worden bij- of afgeschakeld. Dus waarom zetten we componenten die niet gebruikt worden niet gewoon (tijdelijk) uit? Voor de manager van een datacenter heeft dit nu nog iets nachtmerrie-achtigs, want het gaat lijnrecht tegen zijn instinct in. En ook klanten van aanbieders van datacenterdiensten zullen wel even met hun wenkbrauwen fronsen. Maar de vraag blijft: waarom niet? Alles altijd aanlaten kost onnodig veel energie. Het lijkt daarom de moeite waard om hiermee – op kleine schaal – eens uitgebreid te experimenteren.

En als we dan toch aan de gang gaan met experimenten, laten we dan meteen eens kijken naar onze dubbele voedingen. Componenten zijn – standaard – voorzien van een dubbele aansluiting op de netvoeding. Dit gebeurt uit het oogpunt van bedrijfszekerheid. In een datacenter waarin van clusters gebruik wordt gemaakt is dat echter een achterhaald principe. Als je alleen de A-feed gebruikt en de B-feed afschakelt, scheelt dat al gauw 10 procent op het energiegebruik van een totaal cluster. Omdat servers redundant worden uitgevoerd kan dit geen probleem opleveren voor de continuïteit. Mocht een server uitvallen, dan neemt een andere het over.

Keer steeds terug naar de bron

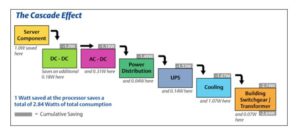

Hoe dichter op de warmtebron je ingrijpt, des te groter het effect. Iedere watt energieverbruik die bespaard wordt bij de processor leidt tot een besparing van 2,84 watt op het geheel van de operatie (bron: Emerson network power). Dit is het zogeheten waterval-effect (zie nevenstaande afbeelding). Daarom is het zo belangrijk om bij allerlei gangbare uitgangspunten van datacentermanagement na te gaan wat zij betekenen voor de energiesituatie aan de bron.

Zoek de grens op

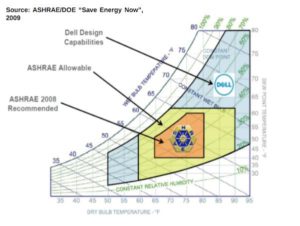

Aan de basis van de gehele architectuur van onze datacenters ligt de recommended envelope, die we eerder noemden. Naast deze recommended envelope (het oranje vlak in de afbeelding) is er een soort gedoogzone van hogere temperaturen die ook geoorloofd zijn (het gele vlak in nevenstaande afbeelding) die volgens de Ashrea, het internationale instituut dat deze normen vaststelt.

Er zijn intussen meerdere fabrikanten van servers waaronder Dell en Supermicro die al syatemen hebben ontwikkeld die voorbij deze allowable grens acteren, namelijk tot 35 graden (de baluwe zone). De vraag is hoever je hierin kunt gaan, vooral omdat processoren bij veel hogere temperaturen in de regel nog steeds goed functioneren.

Er is alleen wel een keerzijde: de keten is immers zo sterk als zijn zwakste schakel. Als je besluit de temperatuur in het datacenter te verhogen moet je er zeker van zijn dat dan alle componenten en de complete inrichting dit aankunnen. Als hier niet goed naar wordt gekeken dan zal dit effect hebben op de storingsgevoeligheid van componenten die niet tolerant zijn voor hogere dan de gangbare temperaturen.

Conclusie

Mijn overtuiging is dat we – zeker in landen met een klimaat als het onze – uitstekend kunnen koelen met uitsluitend buitenlucht. De paar uur in een jaar dat de buitentemperatuur boven de recommended grens uitkomt vallen nog steeds binnen de allowable, dat wil zeggen geoorloofde bandbreedte. Het zal dan even lekker warm worden in het datacenter, net als buiten, maar voor de operatie zal dat geen nadelige gevolgen hebben.

We kunnen voortaan dus in principe zonder koelmachines. Voor de markt is dat op dit moment nog een brug te ver. Wie toch mechanisch wil kunnen blijven koelen kan kiezen voor een hybride systeem met zowel buitenlucht als koelmachines. Deze worden dan alleen aangezet bij temperaturen boven 27 graden. En ook dit bespaart al zeer aanzienlijk op de energierekening. Een alternatief hievoor is adiabatisch koelen met behulp van verdamping.

De verschillende facetten van een luchtiger aanpak van datacentermanagement kunnen gezamenlijk een energiereductie opleveren van meer dan 50 procent. Iets om op zijn minst even bij stil te staan.

Ines Jentink, product manager bij Alticom

Auteur

Ines Jentink is product manager bij Alticom, een uit KPN voortgekomen onderneming die 24 mediatorens in Nederland beheert. In deze torens worden sinds 2009 kleinschalige datacenters gerealiseerd die grotendeels met buitenlucht worden gekoeld.

Er zijn verschillende manieren om koeling in datacenters te bewerkstelligen. Als we het dan toch willen hebben over ‘green’, dan zou ik adviseren te overwegen gebruik te gaan maken van ambiante temperaturen. Warme lucht stijgt vrijwel altijd terwijl dit fenomeen koude lucht achter zich aantrekt. Door meer gebruik te maken van natuureffecten kan zeer goedkoop en goed werkende koeling worden gerealiseerd.

Er is een eenvoudig kleppensysteem die al naar gelang temperatuur eenvoudig een kleppenstelsel openzet waardoor teveel warmte mag ontsnappen en waar koeleren lucht gewoon de serverroom werd ingezogen. Dit onderwerp bestaat al meer dan vijftien jaar en het verbaast me eigenlijk dat we dara nou net niet meer en vaker van horen.